1) 퍼셉트론 : 인간의 실제 신경단위인 뉴런을 본 떠 이를 바탕으로 한 인공신경망(신경망)을 만들게 되고 실제 장치화 한 것. 다수의 입력값에 별도의 가중치를 조절할 수 있으며 이를 바탕으로 출력값을 구할 수 있으며 '학습'이 가능하게 됨. 퍼셉트론, 이를 보완한 아달라인의 등장과 여전히 극복하지 못한 한계 -> XOR 해결 문제 발생 -> 다층 퍼셉트론, 오차 역전파 기법 발생으로 해결

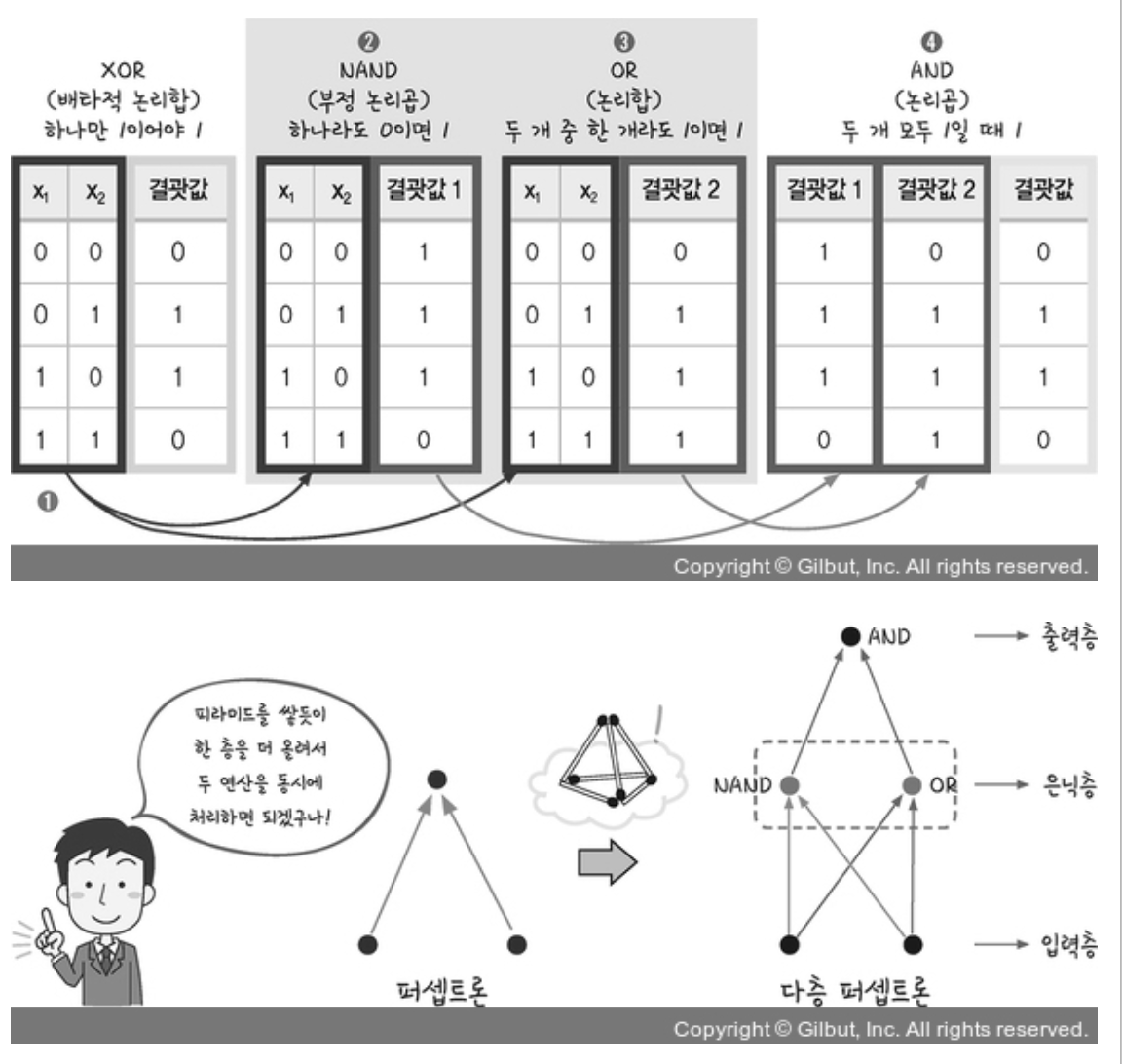

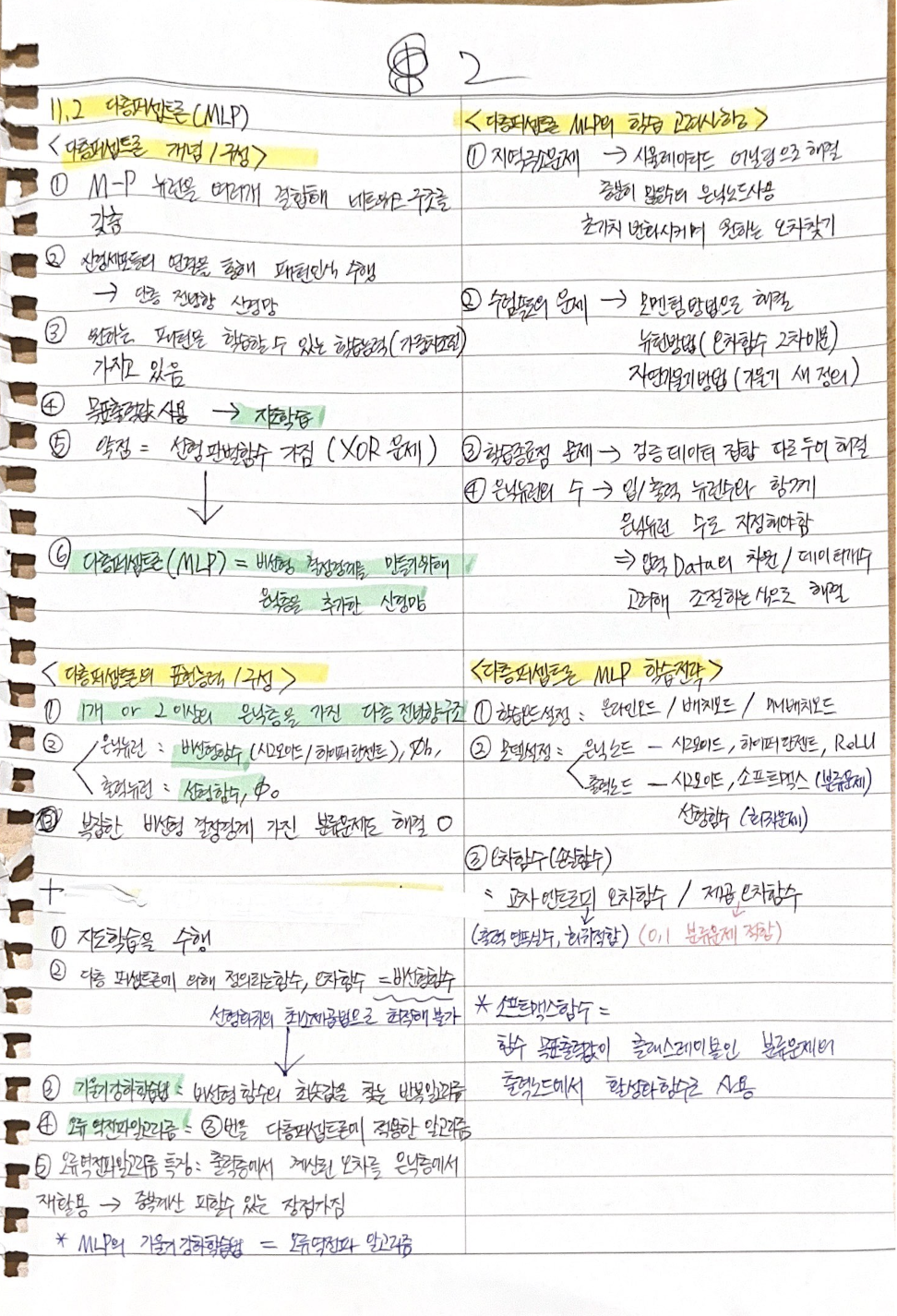

2) 다층 퍼셉트론 (MLP): XOR 문제를 해결할때 각각 NAND, OR 연산과정을 한번 더 거쳐 문제를 해결하며 이 사이에 '은닉층' 이라는 입력층과 출력층 사이의 중간층을 만들어 문제를 해결할 수 있게 됨. 은닉층에서 모은 값은 활성화 함수를 통해 다음 단계로 보내지며 각 활성화 함수로는 시그모이드함수 (σ(x))를 통해 각각의 바이어스와 가중치를 통해 원하는 출력값을 구할 수 있다.

3) 다층 퍼셉트론의 한계 : 은닉층에 포함된 가중치를 업데이트 할 수 없는 문제 발생 -> 오차 역전파 방법으로 해결

4) 오차 역전파 방법 : 다층 퍼셉트론에서 해결할 수 없었던 은닉층의 가중치 문제를 해결하면서 오늘날 딥러닝의 시작점이 됨.

은닉층 가중치 업데이트 방법 => 경사 하강법(임의의 가중치를 선언 후 이를 이용한 결과값을 이용해 오차를 구한뒤 오차가 가장 최소인 지점으로 이동. 즉, 기울기가 0인 지점) 이용하나 이는 단일 입력층 <=> 출력층인 경우에만 가능했음. => 은닉층을 도입한 오차 역전파 방법에선 경사 하강법을 한 번이 아닌 두 번을 실행해서 해결(델타식). => 델타식을 이용해 깊은 신경망 계산 가능 => 깊은 층 계산을 진행할수록 출력층 가중치 업데이트가 처음 층까지 전달되지 않음 => 이는 시그모이드함수 (σ(x))의 한계 때문(미분시 0에가까워지는 문제)에 여러 층을 거칠수록 기울기가 0에 가까워져 가중치 수정하기 어려운 또 다른 문제가 발생 => ReLu 활성화 함수를 통해 해결, 후에 하이퍼볼릭 탄젠츠, 소프트플러스(소프트맥스) 함수 등 다양한 함수 출현

| 시그모이드 함수 | ReLu 함수 | 하이퍼볼릭탄젠트 함수 | 소프트플러스 함수 |

| 미분가능, 출력값제한 | 최근 딥러닝에 사용 0보다 작은 경우 : 0 0보다 큰 경우 : X로 | 미분가능, 출력값 제한 시그모이드가 가지는 한계값을 증가 | 0이 되는 기준을 완하시킴 |

5) 경사 하강법의 한계를 보완한 확률적 경사 하강법

| 경사 하강법 | 확률적 경사 하강법 |

| 한번 업데이트시 전체 데이터 미분 속도가 느림 최적해를 찾기 전까지 최적화 과정이 멈출 수 있음 | 한번 업데이트시 전체 데이터가 아닌 랜덤으로 추출한 일부 데이터만 사용 속도가 빠름 더 자주 업데이트 가능 최적해에 근사값을 찾아내는 장점 -> 오늘날 경사 하강법의 대안으로 사용 |

6) 확률적 경사 하강법이 가지는 중간 결과 진폭이 큰 문제, 불안정한 문제 해결 -> 모멘텀

| 확률적 경사 하강법 | 모멘텀 |

| 최적해를 찾는 과정에서 중간에 진폭이 심하며 불안정한 단점 | 경사 하강법 + 기울기 구할 때 오차를 수정전 바로 앞 수정값과 음양 방향을 참고해 '같은 방향, 일정한 비율' 로만 수정하게 함 => 관성효과, 상대적으로 안정성 획득 |

7) 이외 현재 사용되는 경사 하강법의 발전과정

경사하강법 -> 확률적 경사 하강법 -> 모멘텀(방향조정) -> 네스테로프 모멘텀 -> 아담

확률적 경사 하강법 -> 아다그라드(보폭조정) -> 알엠에스프롭 -> 아담

'통계데이터과학과 및 컴퓨터과학 독서' 카테고리의 다른 글

| 08. 딥러닝 13-15장 (0) | 2023.12.11 |

|---|---|

| 07. 딥러닝 10-12장 (0) | 2023.12.04 |

| 05. 딥러닝 6장 (0) | 2023.11.20 |

| 04. 딥러닝 5장 (0) | 2023.11.13 |

| 03.딥러닝 3-4장 (0) | 2023.11.06 |